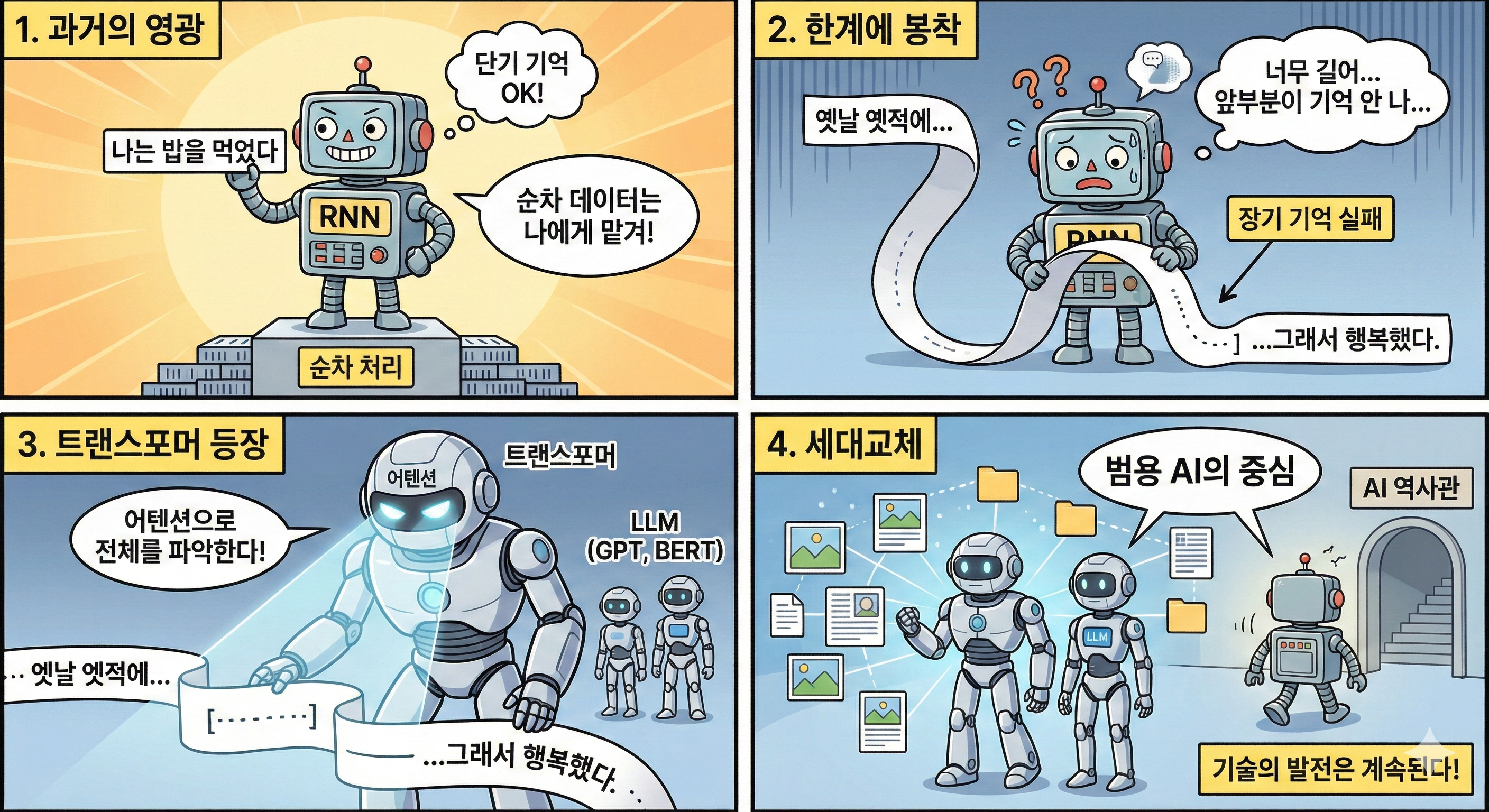

RNN, 한때 혁신적인 기술이었지만, 요즘 들어 그 자리를 잃어가고 있습니다.

과거 순차 데이터 처리의 핵심이었던 RNN이 왜 트랜스포머 기반 AI와 LLM에 밀려나고 있는지, 그 이유를 자세히 살펴보겠습니다.

RNN의 핵심과 한계

RNN(Recurrent Neural Network)은 순차적인 데이터를 처리하는 데 특화된 신경망 아키텍처입니다.

이 모델의 핵심은 '기억'입니다.

바로 직전의 정보를 기억하고 현재 정보를 처리하는 방식으로, 마치 사람이 문맥을 이해하는 것처럼 작동합니다.

예를 들어, "나는 밥을" 다음에 나올 단어를 예측할 때, RNN은 앞선 단어들을 기억하여 "먹었다"와 같은 적절한 단어를 예측할 수 있습니다.

하지만 RNN은 단기 기억에만 능숙하고 장기 기억에는 취약하다는 근본적인 한계를 가지고 있습니다.

문장이 길어질수록 앞부분의 정보가 희석되어 중요한 맥락을 놓치는 경우가 발생합니다.

이는 번역, 텍스트 생성 등 다양한 작업에서 성능 저하로 이어집니다.

트랜스포머의 등장과 RNN의 몰락

RNN의 단점을 극복하기 위해 등장한 것이 바로 트랜스포머(Transformer)입니다.

트랜스포머는 어텐션(Attention) 메커니즘을 사용하여 문장 내의 모든 단어 간의 관계를 파악하고, 장거리 의존성을 효과적으로 처리할 수 있습니다.

즉, 문장이 아무리 길어도 앞부분의 정보를 잊지 않고 전체 맥락을 파악할 수 있다는 뜻입니다.

트랜스포머 기반의 AI 모델, 특히 대규모 언어 모델(LLM)은 자연어 처리 분야에서 혁신적인 발전을 가져왔습니다.

GPT, BERT와 같은 모델들은 텍스트 생성, 번역, 질의응답 등 다양한 task에서 RNN을 압도적인 성능으로 능가하며 빠르게 대체하고 있습니다.

순차적 데이터 처리의 패러다임 변화

RNN이 순차적 데이터 처리에 '특화'되었다는 점은, 역설적으로 트랜스포머에게 자리를 내어주게 된 이유 중 하나입니다.

트랜스포머는 순차적인 데이터뿐만 아니라 이미지, 오디오 등 다양한 형태의 데이터를 처리할 수 있는 범용성을 가지고 있습니다.

하나의 아키텍처로 다양한 task를 수행할 수 있다는 것은 모델 개발 및 유지보수 측면에서 큰 이점을 제공합니다.

최근에는 트랜스포머 아키텍처가 이미지 처리, 음성 인식 등 다양한 분야로 확장되면서, 순차적 데이터 처리에 '만' 특화된 RNN의 입지는 더욱 좁아지고 있습니다.

AWS와 같은 클라우드 서비스에서도 트랜스포머 기반 AI 모델을 적극적으로 지원하며, RNN의 사용 빈도는 점점 줄어드는 추세입니다.

RNN의 흔적과 미래

그렇다고 해서 RNN이 완전히 사라지는 것은 아닙니다.

여전히 일부 task에서는 RNN이 트랜스포머보다 효율적인 경우가 있습니다.

예를 들어, 매우 짧은 시퀀스의 데이터를 처리하거나, 실시간성이 중요한 경우에는 RNN의 단순한 구조가 더 유리할 수 있습니다.

하지만 자연어 처리 연구의 중심은 이미 트랜스포머와 그 후속 모델로 이동했습니다.

최근의 연구들은 트랜스포머의 효율성을 개선하고, 더욱 강력한 성능을 달성하는 데 집중하고 있습니다.

RNN은 과거의 영광을 뒤로하고, 트랜스포머 시대의 조용한 조력자로서 남을 가능성이 높습니다.

RNN이 사라져가는 이유는 결국 기술 발전의 자연스러운 흐름입니다.

더욱 강력하고 효율적인 트랜스포머가 등장하면서, 과거의 기술은 역사의 뒤안길로 사라지는 것이죠.

하지만 RNN이 자연어 처리 분야에 남긴 업적은 결코 잊혀지지 않을 것입니다.

새로운 기술 트렌드를 꾸준히 학습하고 변화에 적응하는 자세가 중요합니다.

'개발' 카테고리의 다른 글

| Transformer 구조 한 장으로 이해하기 (1) | 2026.02.13 |

|---|---|

| LSTM과 GRU의 핵심 차이 (0) | 2026.02.12 |

| CNN이 이미지 인식에 강한 이유 (0) | 2026.02.12 |

| 옵티마이저(Adam, SGD) 차이 설명 (0) | 2026.02.12 |

| 역전파(Backpropagation)를 직관적으로 이해하기 (0) | 2026.02.12 |