Transformer, 단 하나의 구조로 Sequence-To-Sequence 모델의 혁신을 이끌다.

Attention 메커니즘을 핵심으로, 기존 모델의 한계를 뛰어넘는 Transformer 구조를 완벽하게 분석합니다.

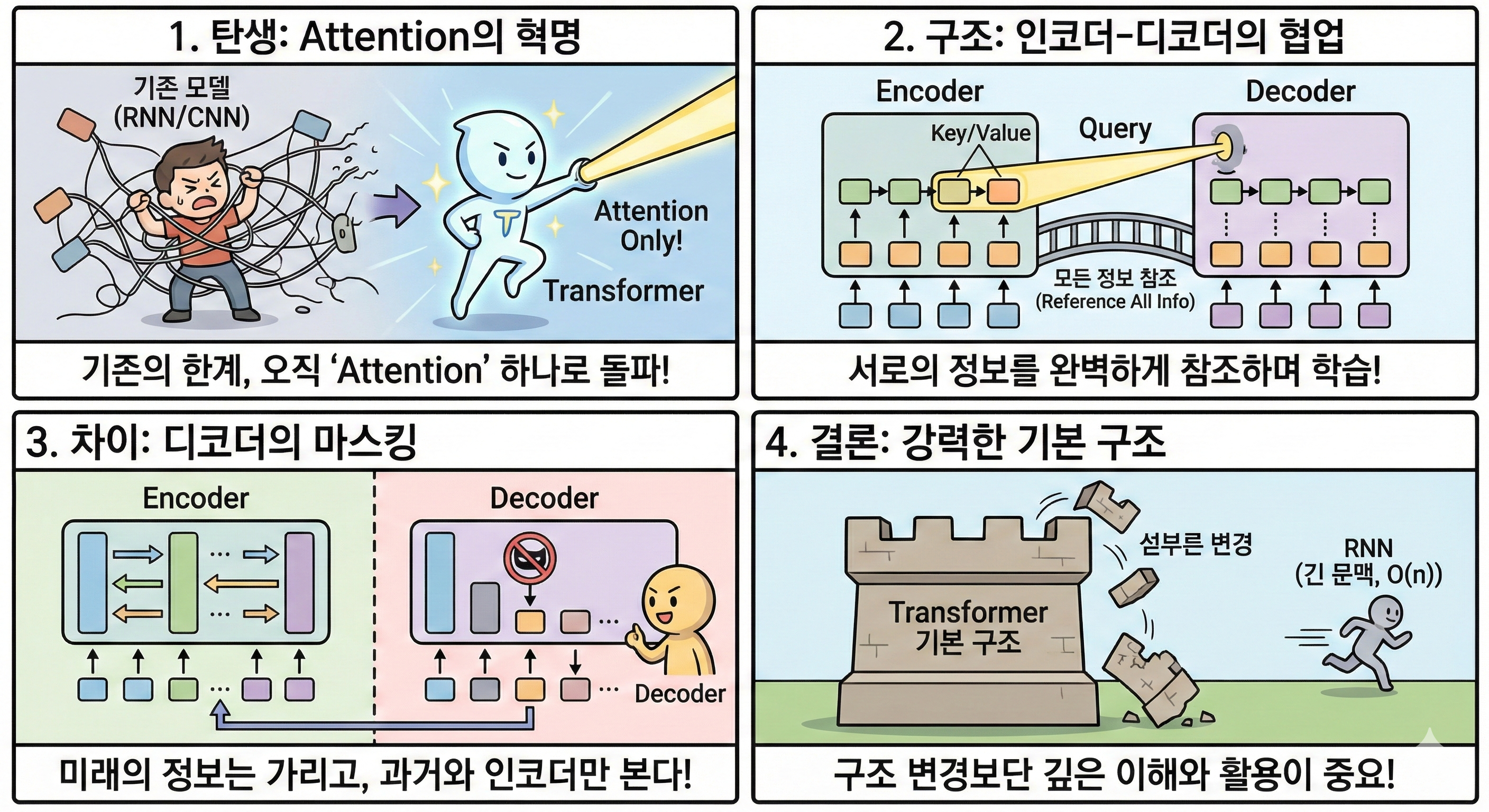

Transformer의 탄생 배경

기존 Sequence-To-Sequence 모델은 고질적인 문제점을 안고 있었습니다.

Transformer는 이러한 문제점을 해결하기 위해 Attention 개념을 도입, 완전히 새로운 네트워크 아키텍처를 제시했습니다.

Attention 메커니즘'만'을 사용하여 구성되었다는 점이 핵심입니다.

Transformer의 기본 구조

Transformer는 크게 Encoder와 Decoder로 구성됩니다.

놀랍게도 Input Embedding과 Output Embedding은 Weight Matrix를 공유합니다.

Decoder는 이전 Decoder Layer에서 Query를, Encoder의 Output에서 Key와 Value를 가져옵니다.

이를 통해 Decoder의 모든 Position Vector들이 Encoder의 모든 Position Vector 값을 참조, Sequence Vector 간의 연관성을 학습합니다.

이 과정이 Transformer의 핵심이라고 할 수 있습니다.

Encoder와 Decoder의 차이점

Transformer Encoder와 Decoder는 구조적으로 매우 유사합니다.

가장 큰 차이점은 Decoder에서 Masking 여부입니다.

Decoder는 앞뒤 문맥을 모두 확인하고 싶을 때, Encoder에게 정보를 참고하여 Sequence를 생성합니다.

이러한 구조적 차이가 Transformer의 강력한 성능을 뒷받침합니다.

Layer Normalization의 중요성

Layer Normalization의 위치는 학습 안정성에 큰 영향을 미칩니다.

Self-Attention 앞에 Layer Normalization을 넣느냐, 뒤에 넣느냐에 따라 학습 결과가 달라질 수 있습니다.

최적의 학습 결과를 위해서는 Layer Normalization 위치에 대한 신중한 고려가 필요합니다.

Transformer 구조 변경의 효과

최근, 긴 문맥을 처리해야 할 때 RNN 계열 모델이 다시 주목받고 있습니다.

RNN은 O(n)의 연산량으로 긴 문맥 처리가 가능하기 때문입니다.

하지만 Transformer 기본 구조 자체가 워낙 강력하기 때문에, 구조 변경이 성능 향상으로 이어질지는 미지수입니다.

실제로 대부분의 구조 변경 시도는 괄목할 만한 성능 향상을 보여주지 못했습니다.

Transformer는 Attention 메커니즘을 기반으로 Sequence-To-Sequence 모델의 새로운 지평을 열었습니다.

Encoder와 Decoder의 유기적인 연결, Layer Normalization의 전략적 배치, 그리고 RNN과의 비교를 통해 Transformer의 구조적 강점을 이해하는 것이 중요합니다.

Transformer의 기본 구조는 매우 강력하며, 섣부른 구조 변경보다는 기존 구조를 깊이 이해하고 활용하는 것이 더욱 효과적일 수 있습니다.

꾸준한 연구와 실험을 통해 Transformer의 잠재력을 최대한으로 끌어올리시길 바랍니다.

'개발' 카테고리의 다른 글

| 딥러닝 모델 학습이 느린 이유 (0) | 2026.02.13 |

|---|---|

| Attention 메커니즘이 혁신인 이유 (0) | 2026.02.13 |

| LSTM과 GRU의 핵심 차이 (0) | 2026.02.12 |

| RNN은 왜 사라지고 있을까? (0) | 2026.02.12 |

| CNN이 이미지 인식에 강한 이유 (0) | 2026.02.12 |